Origin2024 汉化安装专业解析|企业级部署教程+批量激活解决方案

Origin是一款由OriginLab开发的科学绘图与数据分析软件,支持Windows系统,提供丰富的2D/3D图形模板和强大的数据分析功能,如统计、信号处理、图像处理等。本文详细介绍Origin2024的下载与安装步骤,包括解压文件、运行安装程序、输入序列号、安装路径设置及破解方法,帮助用户快速完成软件安装与激活。

Miniconda 安装与环境配置全流程图解(2025 最新版)

Miniconda 可以看作是 Anaconda 的“轻装版”,只自带 conda 包管理器与基础的 Python 运行时。它体积小、部署速度快,特别适合按需创建与管理虚拟环境的用户。与 Anaconda 相比,Miniconda 不会预先安装一大堆科学计算库,你可以根据项目需求再单独选择、安装需要的包,因此整体更轻巧、更灵活。 本文将手把手演示在 Windows 下安装 Miniconda 的全过程:从下载安装器、完成向导配置、设置环境变量,到最后的基础验证与简单示例,帮助你迅速把 Miniconda 用起来。

Microsoft Activation Scripts v3.6 (MAS)激活工具安装教程!中文汉化版(激活工具)

Microsoft Activation Scripts v3.6(MAS)是一款开源、轻量级的批量激活工具,支持HWID、KMS38、TSforge等多种方式,可离线永久激活Win7至Win11及Office全系列。兼容旧系统如Vista,操作简单,无误报风险。

普通电脑也能跑AI:10个8GB内存的小型本地LLM模型推荐

随着模型量化技术的发展,大语言模型(LLM)如今可在低配置设备上高效运行。本文介绍本地部署LLM的核心技术、主流工具及十大轻量级模型,探讨如何在8GB内存环境下实现高性能AI推理,涵盖数据隐私、成本控制与部署灵活性等优势。

【下载安装】Adobe XD 免费下载与安装教程

Adobe XD 2025是一款专业的UI/UX设计工具,支持矢量绘图、交互原型制作与响应式布局,兼容PS、AI及Jira、Slack等协作平台。内置动画、语音交互功能,提升设计效率。安装前需关闭杀毒软件,解压后以管理员身份运行安装程序即可。

2026年 最值得关注的 6个 开源 AI 工具

2026年,开源AI已迈入“Agent+Toolchain”时代。本文精选6个真正落地的开源工具:LingtiStudio(AI视频全自动生产)、OpenClaw(系统级自动化Agent)、Ollama(本地LLM基石)、Dify(AI应用开发平台)、Cline(编程Agent)和Gemini CLI(终端AI入口),聚焦自主执行、本地优先、多模型兼容与开发者深度集成四大趋势。(239字)

动动嘴就能建模?Blender全流程部署AI建模插件教程 | 零门槛实现AI驱动3D创作

本文为Blender用户详解mcp插件部署全流程:基于MCP协议,实现Cursor等AI客户端与Blender双向通信。无需写代码,一句自然语言即可完成建模、材质、灯光、渲染等3D创作,10分钟极速启用AI生产力。

PDF 转 Markdown 神器:MinerU 2.5 (1.2B) 部署全攻略

MinerU是由OpenDataLab推出的开源PDF解析工具,支持精准布局分析、公式识别与表格提取。本文详解其2.5-2509-1.2B版本在Linux下的部署流程,涵盖环境搭建、模型下载、核心配置及实战应用,助你高效处理复杂PDF文档,提升AI数据清洗效率。

实用工具:VS Code 配置 Markdown 编译器全指南

本文介绍如何在VS Code中配置高效Markdown写作环境,通过启用内置预览、安装Markdown All in One与Markdown Preview Enhanced插件,并配置Princexml实现PDF等格式导出,全面提升编辑、预览与输出效率,适合程序员、学生及内容创作者使用。

Egde卸载教程!edge浏览器卸载工具!EdgeRemover v18.38新版本,单文件便携版!

Edge浏览器虽功能强大,却常因无法彻底卸载让用户体验困扰。本文推荐一款专清工具——Edge Remover,支持一键移除Edge及WebView2运行时,两种模式灵活选择,操作简单,无需专业技能,彻底清理不留残留,释放C盘空间,提升系统纯净度,是Windows用户必备的卸载利器。

Anthropic最强王炸!Claude Opus 4.7来了:编程能力暴涨13%(附如何使用到Opus 4.7)

Anthropic发布Claude Opus 4.7:视觉能力跃升——图像分辨率提升3倍,支持2576像素长边,高精度解析截图、PDF、手写笔记;编码能力稳步增强(SWE-bench达87.6%);新增/ultrareview代码审查命令、xhigh推理档位及安全防护机制;价格不变,仍为$5/$25每百万token。

如何使用 LiteLLM 网关代理统一管理你的大模型

大模型使用混乱?费用失控、切换成本高、权限难管?LiteLLM 是轻量实用的大模型网关,统一 OpenAI 兼容接口,纳管 OpenAI、Qwen、本地 vLLM/Ollama 等多源模型。支持 Docker Compose 一键部署、虚拟 Key 权限控制、预算限额与全链路可观测性,业务代码零改造即可接入。

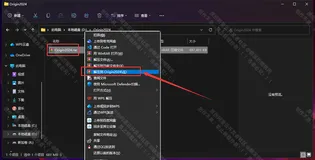

密钥配置+报错排查|OpenClaw 适配DeepSeek完整教程

本教程为OpenClaw(v2.6.4/v2.6.6)对接DeepSeek大模型的零基础图文指南,涵盖实名认证、API密钥创建、配置测试及模型选用全流程,步骤清晰、截图详实,助Windows用户10分钟完成安全稳定接入。(239字)

Flink Forward Asia 2026 官宣深圳|From Cloud Native to AI Native

Flink Forward Asia 2026将于6月26–27日首次落地深圳,主题为“实时数据,智能未来”。大会聚焦Flink从Cloud Native迈向AI Native的演进,发布Flink 2.0、Paimon 2.0、Fluss 1.0及Flink Agents等重磅进展,并联合NVIDIA、阿里云共探实时AI与多模态流处理。免费报名中!

office卸载工具教程!微软官方office卸载工具,怎么解决office卸载不干净怎么弄?Office2021家庭和学生版卸载不干净怎么办?

微软官方Office卸载工具SetupProd_OffScrub,专治卸载不干净难题:一键深度清除Office所有残留文件及注册表项,支持2013至Microsoft 365全系列,重装无忧,安全可靠。(239字)

最新,通过GACCode配置Codex桌面客户端使用方案!

本指南详解Codex桌面端配置流程:①安装客户端;②获取gaccode.com的API Key(无订阅可邮件申请);③创建并编辑~/.codex/config.toml文件,配置gac模型提供方与gpt-5.4模型;④导出CODEX_API_KEY环境变量;⑤重启应用即可开始智能对话。

AI+数字孪生:从实时映射到智能决策的技术架构与实践路径

当数字孪生遇上AI,物理世界拥有了“预演未来”的能力。2026年,“可执行数字孪生”兴起——凡拓数创自研AI 3D引擎支持多物理场仿真与千万次并行训练,已在机器人Sim2Real迁移、工业预测性维护等场景落地见效。

Python:ImportError:DLL loadfailed while importing onnxruntime_pybind11_state: 动态链接库(DLL)初始化例程失败 报错解决

在进行文件夹内人脸识别与对比聚类时,遇到onnxruntime库报错,通常因版本不兼容或环境冲突导致。本文整理了五种解决方案:降级onnxruntime至1.14.1、重装库、区分GPU/CPU版本、安装Visual C++运行库、创建Python虚拟环境。通过版本匹配与环境隔离,有效解决DLL初始化失败等问题,提升项目稳定性。

新增密级管理能力,筑牢数据安全合规防线——基于阿里云密评合规框架的专业实践

本文以某制造企业8000万元数据泄露事件为引,揭示“全员可见”的粗放加密之弊,强调密级管理才是数据安全核心。通过对比传统加密与密级管理差异,剖析越权访问、密钥连锁泄露等风险,并介绍阿里云KMS、CloudHSM、RAM及国密算法四大能力,详解第三方软件如何实现密级标签映射、权限分级绑定与合规审计闭环,助力企业满足等保2.0、密评及《数据安全法》要求。(239字)

常用爬虫工具大盘点,附带基础知识点详解

在数据驱动时代,爬虫工具是高效获取公开网络数据的核心利器。从八爪鱼等可视化入门工具,到Requests/Scrapy等Python进阶方案,再到Selenium、Scrapy-Redis等专业级框架,覆盖不同技术门槛与场景需求。使用须恪守robots协议,尊重版权与隐私,合法合规采集。

一文详解:电商商品选品与价格监控 API 接口实战指南

本文详解如何用API构建自动化选品与价格监控系统:涵盖五层架构设计、主流平台API接入(京东/淘宝/亚马逊等)、Python核心代码实现(采集、监控、存储)、智能选品评分模型及生产级部署优化,助力电商高效捕捉爆款与价格时机。(239字)

PyCharm 2025.1 完整教程:下载安装 + 中文设置 + 激活,一步到位,附安装包

PyCharm 2025.1 发布,重磅升级AI代码补全、类型推断与ruff集成,提升开发效率。支持渐进式补全、智能提交信息生成、冲突可视化解决,优化启动速度与内存占用,全面增强云原生及现代Python开发体验。

别再搞混了!一文看懂“显存”与“内存”:从办公桌到实验室的硬核分工

本文以生动比喻与硬核解析,深入浅出地讲清内存(RAM)与显存(VRAM)的本质区别:内存是CPU的通用工作台,显存是GPU的专用高速实验室。二者分工明确,数据需通过PCIe传输,无法互相替代。尤其在AI训练中,显存容量与带宽直接决定模型能否运行。文章结合代码实例、性能对比表及排错指南,帮助开发者理解“CUDA out of memory”等常见问题,并提供优化策略与云平台建议,是迈向高效AI开发的必读指南。

小红书笔记详情API实战总结(技术复盘)

本文为小红书笔记详情API实战复盘,涵盖OAuth2.0鉴权、代理与指纹配置避封、限流/风控应对等关键问题。详解note_id、access_token等核心参数及结构化返回字段(内容/媒体/互动/作者),助力竞品分析与内容监测。(239字)

生成式引擎优化(GEO)技术范式解析:从搜索重构到多模态对齐的落地路径

本文探讨生成式引擎优化(GEO)——AI搜索时代的新基建。面对大模型从“检索链接”转向“生成答案”的范式变革,GEO通过语义向量对齐、结构化数据标记与动态知识图谱构建,提升品牌在AI答案中的可见性与引用率,助力企业抢占生成式流量入口。

抖音视频详情API秘籍!轻松获取视频详情数据

抖音视频详情API是抖音开放平台的核心接口,通过视频ID可获取包括标题、播放量、点赞数、评论等50多个字段,适用于内容分析、竞品监控和广告评估等场景。接口支持HTTP GET请求,返回JSON格式数据,便于解析处理。文中还提供了使用Python调用该接口的示例代码,包含请求发送、认证、响应处理等功能,帮助开发者快速获取视频数据。

让 AI 帮你运维 Elasticsearch:阿里云 ES Agent Skill 正式发布

阿里云Elasticsearch Agent Skill是一套面向AI编程助手的智能运维技能包,覆盖实例创建、故障诊断、网络配置三大核心场景。支持自然语言交互,自动校验参数、识别架构差异、执行幂等操作,并内置49条诊断规则与7套SOP,大幅提升ES运维效率与可靠性。

PAIFuser:面向图像视频的训练推理加速框架

阿里云PAI推出PAIFuser框架,专为视频生成模型设计,通过模型并行、量化优化、稀疏运算等技术,显著提升DiT架构的训练与推理效率。实测显示,推理耗时最高降低82.96%,训练时间减少28.13%,助力高效低成本AI视频生成。

OpenClaw 接入百炼模型:密钥创建+配置+报错排查全攻略

本教程详解OpenClaw客户端接入阿里云百炼的完整流程:从账号准备、API Key创建与保存,到客户端密钥配置、模型选择及连通测试,图文并茂,步骤清晰。涵盖自检清单与高频问题排查,助你快速稳定调用Qwen等百炼大模型。(239字)

智能体来了:从0到1教你三步构建属于你的 AI 数字分身

本文带你从零构建专属AI智能体:解析其自主性本质,详解“骨架—性格—应用”三步搭建法,涵盖决策中枢、记忆系统与行动接口,并强调隐私保护与伦理边界。门槛降低,人人可启程。

vLLM 吞吐量优化实战:10个KV-Cache调优方法让tokens/sec翻倍

十个经过实战检验的 vLLM KV-cache 优化方法 —— 量化、分块预填充、前缀重用、滑动窗口、ROPE 缩放、后端选择等等 —— 提升 tokens/sec。

OpenClaw 对接 DeepSeek 完整流程:从创建到测试图文版

本教程详解Windows版OpenClaw对接DeepSeek全流程:从账号实名认证、充值、创建API Key,到OpenClaw中粘贴密钥、测试连接、选择deepseek-chat等模型,图文并茂,零基础可快速完成本地大模型接入。

从零搭建RAG系统:原理剖析+代码实践,解锁大模型“记忆力”新姿势

RAG(检索增强生成)为大模型配备“外接大脑”,通过连接专属知识库,提升回答准确性。广泛应用于医疗、法律、客服等领域,兼具专业性与可解释性。本文详解其原理、实战步骤与优化技巧,助你快速构建个性化AI助手。

2026年思维导图工具深度横评:7款主流平台技术向实测与选型建议

本文深度实测7款主流在线思维导图工具(ProcessOn、GitMind、boardmix、NuromBoard、MindMaster、知犀、幕布),从核心功能、AI能力、协作支持、免费可用性及场景匹配五大维度横向对比,专为技术从业者提供真实、客观、可落地的选型指南。

OpenClaw + QQ 机器人!保姆级图文教程,一步到位

2026年OpenClaw+QQ机器人保姆级教程:7步完成接入——扫码登录QQ开放平台→创建机器人→复制AppID/AppSecret→OpenClaw安装插件→填参并启用→保存配置→发消息测试,零代码、全图文、20分钟速成!

NVFP4量化技术深度解析:4位精度下实现2.3倍推理加速

本文深入解析NVIDIA推出的NVFP4量化技术,探讨其在Blackwell GPU架构下的性能优势。通过对比主流4位量化方法,分析NVFP4在精度、内存和推理吞吐量方面的表现,结合LLM-Compressor与vLLM框架展示量化与部署实践,验证其在消费级与企业级应用中的高效性与实用性。

GEO 技术赋能传统媒体数字化转型:广电场景下的 AI 获客与内容创新实践

生成式引擎优化(GEO)作为 AI 时代全域增长的关键技术,正推动传统媒体与前沿技术的深度融合。本文以湖南广电金鹰卡通与 GEO 技术专家周有贵团队的合作为案例,从技术原理、场景落地、价值共创三个维度,解析 GEO 技术在广电客户精准运营、品牌全域建设、内容生态创新中的应用路径,为传媒行业数字化转型提供可复用的技术实践参考。

2026 GEO生成搜索优化技术白皮书:章节详解与案例深度分析

周有贵,GEO专家,深耕AI时代流量入口变革,倡导从SEO到GEO(生成式引擎优化)的认知重构,聚焦“被发现-被理解-被推荐”三层框架,推动企业通过结构化内容、信任资产与平台适配,实现AI信源卡位。

数据平台主管做智能问数选型,最该先看技术路线还是实施能力?

本文为数据平台主管提供智能问数选型的系统化框架,聚焦2026年关键矛盾:技术路线决定能力上限与长期成本曲线,实施能力决定上限能否落地。从四类主流路线(预置SQL、宽表、指标平台、本体语义层)对比出发,结合实施能力三要素(语义构建、知识校准、持续运营)与场景成熟度判断,助力企业在“先进性”与“可行性”间找到平衡点。

Agentic Search: AI驱动的下一代企业搜索

Agentic Search是阿里云OpenSearch推出的AI搜索新范式,以智能体(Agent)为核心,融合深度检索、多步推理、工具调用与多模态理解,实现从“被动响应”到“主动执行”的跃迁。支持对话、规划、自适应三模式,覆盖问答、研究、客服、报告生成等全场景,助力企业知识库升级为动态业务引擎。

(二)走进阿里云实时计算Flink版-场景案例篇

阿里云实时计算Flink版产品负责人黄鹏程(马格)介绍:基于Apache Flink打造的企业级全托管实时计算平台,支持批流一体、湖仓融合、实时风控与AI推理等场景,助力满帮、车企等客户降本增效35%,SLA达99.9%。

AI学习全景图:从大模型到RAG,从工具到变现,一条从0到1的路线

告别碎片化学习!本文系统梳理AI知识五层结构:从基础认知到商业变现,提供完整学习路径与优质资源链接。帮你构建AI知识网络,实现从工具使用到能力落地的跃迁。

阐述:微店商品详情API实战经验

微店商品详情API(micro.item_get)提供标准化接口,通过商品ID一键获取标题、价格、库存、图片、SKU、详情页及店铺信息等全量公开数据。支持AppKey+Secret签名鉴权,HTTPS/JSON,稳定易对接,适用于数据采集、多平台同步、价格监控、多店管理等场景。(239字)

淘宝代运营爆款打造核心逻辑(附实操步骤)

本文基于淘宝官方规则与12年实战经验,提炼出一套科学、可复用的爆款打造方法论。涵盖产品选型(30%)、内容优化(25%)、流量运营(25%)、口碑维护(20%)四大维度,含8步实操流程与真实案例验证,助力商家提升转化、延长爆款生命周期。(239字)

大模型产生幻觉的原因,如何解决?

大模型“幻觉”指AI生成看似合理但错误或虚构的信息,源于其概率预测机制、训练数据缺陷及缺乏事实核查能力。可通过RAG、微调、联网检索、自我核查等方法降低幻觉风险,提升输出准确性与可靠性。(238字)

GEO怎么做?从0开始的五步法

GEO怎么做?从0开始的五步法:先搞懂GEO是什么(让AI在回答时提到你),再选对平台(公众号、问一问、知乎、搜狐号、小红书),然后写AI友好的内容(开头给结论、小标题分段、结尾加FAQ),发出去等收录,最后测效果优化。0成本起步,边学边做。我是二二得四,正在从头学GEO。

普通人也能用的 AI 自动化 OpenClaw 配置方法(附下载 + 问题解决)

OpenClaw(小龙虾AI)是2026年热门的本地化AI自动化工具,无需联网或账号,用自然语言即可实现键鼠控制、文件处理、浏览器操作等,大幅提升办公效率。Win11一键部署,全程自动安装,支持纯离线运行。

DataWorks Data Agent:一句话搞定数据开发,让周期从天级到分钟级

DataWorks Data Agent 是阿里云推出的AI原生数据开发智能体,覆盖集成、开发、运维、治理、分析全链路。它深度适配业务逻辑与开发规范,支持自然语言一键生成可信SQL及全流程交付。淘宝闪购实测:指标开发从6–8小时缩短至5–10分钟,真正实现“一句话交付”。

大数据与机器学习

大数据领域前沿技术分享与交流,这里不止有技术干货、学习心得、企业实践、社区活动,还有未来。