Flink CDC在抽取全量Oracle数据库数据时有遇到这样的问题吗?这个问题是数据内容导致还是配置导致?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

你可以跑完全量之后停掉任务,改小一些内存之后再起任务,但是万一某个时间段binlog极速增加,然后做checkpoint需要大量数据,你到时候就任务失败了 ,此回答整理自钉群“Flink CDC 社区”

是的,Flink CDC在抽取全量Oracle数据库数据时可能会遇到这样的问题。这是因为Flink CDC需要从Oracle数据库中获取数据,然后将这些数据转换为Flink可以处理的格式。在这个过程中,可能会出现各种错误,例如连接问题、数据类型不匹配、文件格式错误等。

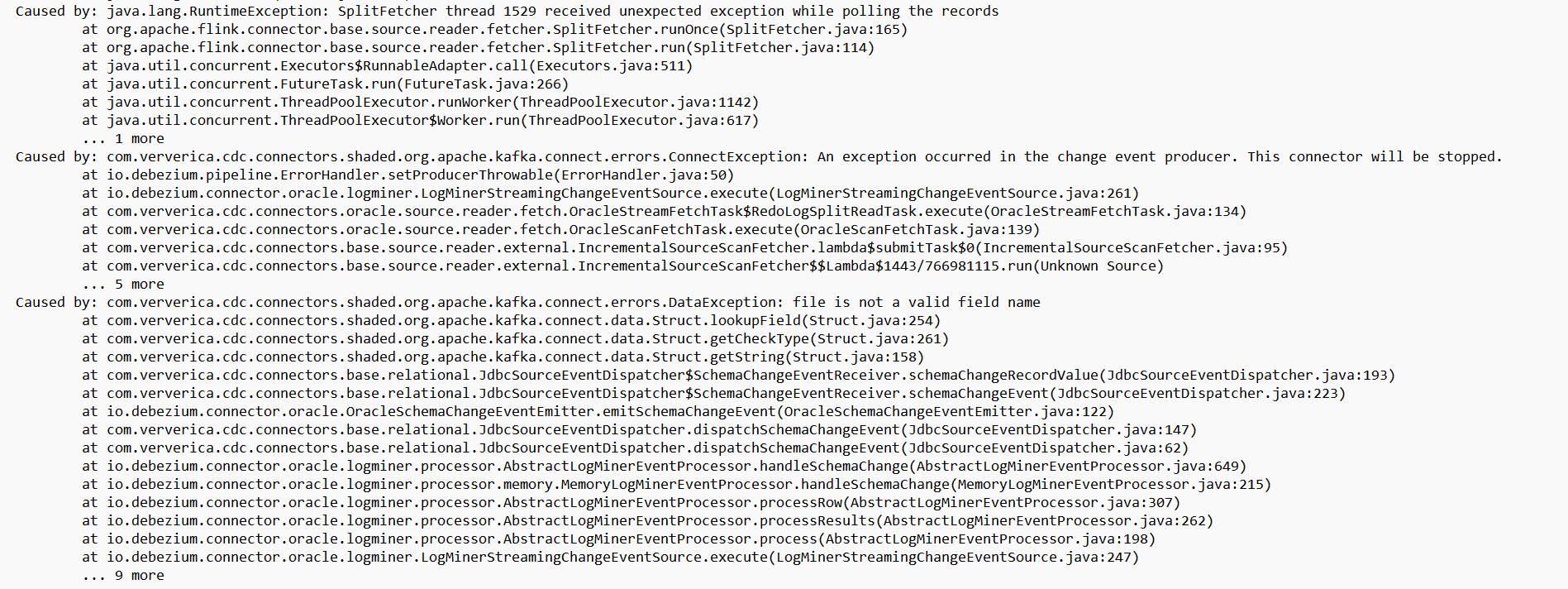

在你的错误信息中,有一个异常是 com.ververica.cdc.connectors.shaded.org.apache.kafka.connect.errors.ConnectException: An exception occurred in the change event producer. This connector will be stopped. 这个异常表明在将数据发送到Kafka时发生了错误。

另一个异常是 com.ververica.cdc.connectors.shaded.org.apache.kafka.connect.errors.DataException: file is not a valid field name。这个异常表明在处理数据时发生了错误,可能是数据格式不正确或者数据类型不匹配。

如果你遇到了这样的问题,你可以尝试以下几种解决方法:

这个问题可能是由于Oracle数据库中的字段名不符合Kafka Connect的要求导致的。在Oracle数据库中,字段名不能包含空格、特殊字符等非字母数字字符。你需要检查你的Oracle数据库表结构,确保所有字段名都是有效的。

另外,你可以尝试在Flink CDC的配置中添加以下参数,以允许使用非标准字符作为字段名:

{

"transforms": "your_transform",

"transforms.your_transform.type": "org.apache.flink.connector.jdbc.JdbcSource",

"transforms.your_transform.table-name": "your_table",

"transforms.your_transform.username": "your_username",

"transforms.your_transform.password": "your_password",

"transforms.your_transform.column.names": "your_column_names",

"transforms.your_transform.column.types": "your_column_types",

"transforms.your_transform.fetch.size": "your_fetch_size",

"transforms.your_transform.max-num-records": "your_max_num_records",

"transforms.your_transform.poll-interval": "your_poll_interval",

"transforms.your_transform.timestamp-millis": "your_timestamp_millis",

"transforms.your_transform.timestamp-millis-watermark-delay": "your_timestamp_millis_watermark_delay",

"transforms.your_transform.timestamp-extractor.class": "your_timestamp_extractor_class",

"transforms.your_transform.timestamp-extractor.field": "your_timestamp_extractor_field"

}

请将上述代码中的your_transform、your_table、your_username、your_password、your_column_names、your_column_types、your_fetch_size、your_max_num_records、your_poll_interval、your_timestamp_millis、your_timestamp_millis_watermark_delay、your_timestamp_extractor_class和your_timestamp_extractor_field替换为你的实际配置。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。