在企业智能应用选型过程中,模型只是工具,真正关心的是整体方案的可实施性,包括成本、稳定性、合规,以及能否平稳演进和灵活切换。

先梳理下实际落地场景下的策略方向:

- 强化通用能力、丰富生态及工具链:可以着重考虑 GPT-5.4

- 提升研发效能、复杂代码处理、长文档理解与 Agent 场景:可重点评估 Claude 4.6(Opus 适合高复杂任务,Sonnet 更适合高频场景)

- 保障生产连续性:建议采用主模型 + 备用模型架构,在前置层搭建统一接入,切换实现自动化

明确业务场景,合理拆分选型逻辑

建议将业务场景分为三类:

- 研发协作类(如代码生成、重构、审查、自动化等):关注长上下文支持与推理稳定性

- 知识处理类(如RAG、文档总结、制度/法务/投研等):关注上下文窗口、输出能力与成本结构

- 产品互动类(如智能助手、客服、内容生成等):关注生态工具、可观测性及整体接入便利性

硬性参数比对:上下文、输出、定价

以下为主要模型官方参数(单位:USD / 百万 tokens(MTok)):

| 项目 | GPT-5.4 | Claude Opus 4.6 | Claude Sonnet 4.6 |

|---|---|---|---|

| 上下文窗口 | 1,050,000 tokens | 1,000,000 tokens | 1,000,000 tokens |

| 最大输出 | 128,000 tokens | 128,000 tokens | 64,000 tokens |

| 输入单价 | $2.50 / MTok | $5 / MTok | $3 / MTok |

| 输出单价 | $15 / MTok | $25 / MTok | $15 / MTok |

| 缓存读(命中) | $0.25 / MTok | $0.50 / MTok | $0.30 / MTok |

企业用户建议关注两类细节:

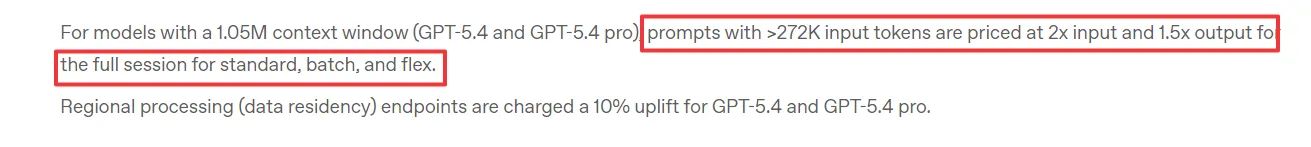

- GPT-5.4 上下文超限时倍率:若单次输入超过 272K tokens,将触发单价上浮(输入 2x,输出 1.5x),RAG 类业务如需大规模拼接需重点关注成本敏感度。

- Claude 4.6 长上下文能力:Opus/Sonnet 皆为 1M tokens 且按标准价,无需单独付费或激活,适合主流程及需求稳定的场景。

治理费用的实用建议

成本优化核心不是单纯更换更廉价模型,而是工程化调用与分场景治理:

- 缓存机制:主流大模型均支持缓存计费。建议缓存长系统提示、标准知识、工具定义等重复内容,降低 token 消耗。

- 批处理模式:针对不追求实时性的批量任务(如日结报告、质检、批量分析),Batch API 通常可获得显著折扣(部分平台官方直接明示可达 50% 优惠)。

- 输入/输出分类监控:将输入与输出分开计量,企业实际消耗“拉高”常出现在长输出任务,需区别分析。

治理与架构建议:关注解耦与可观测

建议企业将大模型能力作为可插拔服务进行系统集成,分层治理:

- 统一接入网关:面向业务提供标准 API,内部自动适配不同模型

- 智能路由与容灾:主备模型自动切换,同业务多模型异构兜底

- 调用与状态可观测:每轮调用的 token 数、用时、异常、模型类型须全量留痕,便于追溯和优化

- 合规和地域策略:根据业务要求选择区域推理/数据驻留能力,并评估相应成本(部分平台明示有地区加价/倍率)

注:OpenAI、Anthropic 官方文档均透露某些地区服务会有单价调整,建议企业设计前评估此类合规要素,并纳入成本统筹。

国内企业接入要点:链路与结算实际复杂

对本地企业而言,模型选型外,链路质量、结算合规(例如币种、合同、发票)与运维复杂度实际影响最大。

因此,聚合平台成为通用选项,例如(以社区里讨论的 147api 公共资料为例):

- 多模型聚合(对接 GPT / Claude / Gemini 等主流大模型)

- 兼容 OpenAI API(迁移门槛低)

- 企业结算友好(支持人民币合规结算,对公账号等)

- 服务与SLA(部分平台公布 SLA,如 99.9% 连续性)

这类方案的优势在于将接入风险从业务端移至平台网关,便于快速扩展和稳定运维。

总结与建议

总之,企业在大模型选型时无需纠结“谁最强”,而应结合自身业务需求、治理能力和未来可扩展性进行整体考量。主流模型能力日趋趋同,真正决定落地效率的,是业务场景与成本结构的匹配,以及架构层面对接入、治理、可观测、合规等因素的提前布局。

建议从以下几个方面入手:

- 用业务驱动决策,按条线拆分模型选型,不盲目追新,但要留有切换和备份空间;

- 重视治理与合规,尽量将模型能力与业务解耦,提升系统弹性与风险应对能力;

- 优先选用聚合平台或统一接入网关,降低未来切换、扩容和后续运营成本;

- 持续评估市场和政策变动,定期复盘选型、计费、合规与运维,保持架构灵活。

未来,AI 模型能力迭代愈发频繁,无论 Claude 还是 GPT,只要结合企业实际场景搭好架构、提前考虑好“接入—治理—切换—降本”全流程,就能够最大程度发挥大模型价值,为业务创新和增长持续赋能。