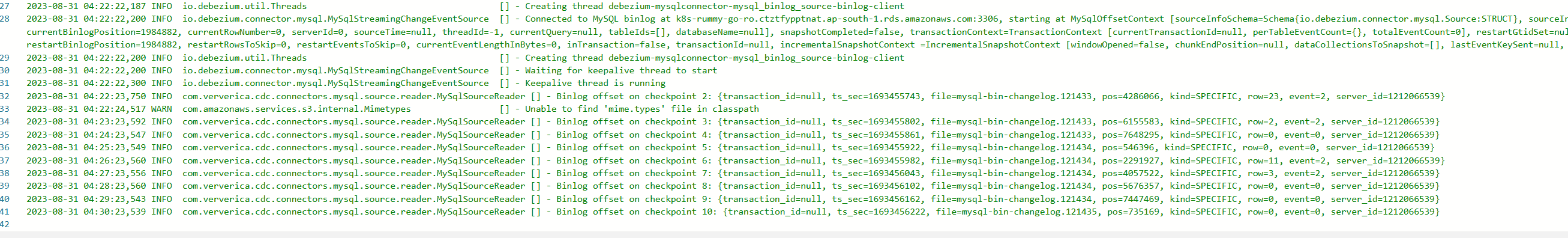

Flink CDC taskManage日志一直打印这个,但是没有往下游写数据是怎么回事?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

当Flink CDC TaskManager日志中打印一条信息而没有往下游写数据时,可能会有以下几个可能的原因:

数据源问题:首先,您需要确认数据源是否正常。检查数据源是否正常产生数据,并且是否与Flink CDC TaskManager建立了正确的连接。查看数据源的日志或监控信息,确保数据源没有发生故障或连接问题。

Flink CDC配置问题:检查Flink CDC任务的配置是否正确。确保Flink CDC任务设置了正确的输入源(例如Kafka)和正确的目标(例如StarRocks)。检查Flink CDC任务的配置文件是否有任何错误或缺失。

数据过滤或转换问题:检查Flink CDC任务是否对数据进行了过滤或转换。如果任务配置了过滤条件或数据转换逻辑,并且数据不符合这些条件或逻辑,可能导致数据没有被写入下游。

资源问题:确保Flink TaskManager有足够的资源来执行任务。检查TaskManager的资源使用情况,包括内存、CPU等。如果资源不足,可能会导致任务无法正常执行。

Flink CDC版本或Bug问题:在某些情况下,特定版本的Flink CDC可能存在Bug或问题,导致数据没有被写入下游。您可以尝试使用最新的Flink CDC版本,或者参考Flink社区或论坛中是否有与您遇到的问题相关的Bug报告和解决方案。

如果您仍然无法解决问题,建议您提供更多的日志和配置信息,以便更好地理解和分析具体的情况。您可以在Flink社区或论坛上咨询,或向Flink的官方技术支持团队寻求帮助。他们将能够更准确地诊断和解决您的问题。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。