各位大佬,请教个问题,刚开始用flink1.17.1版本,写入到测试环境自建的kafka,数据能写入。写入到阿里云的kafka实例,数据无法写入。之前使用1.13.6往阿里云kafka可以正常写?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

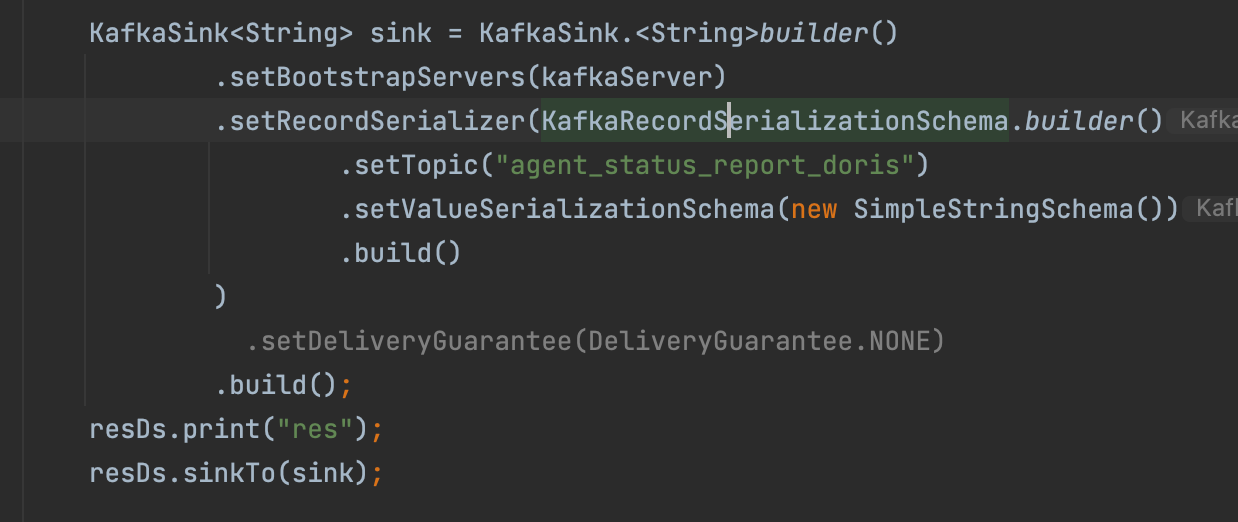

可以的,以下是简单的示例代码:

import org.apache.flink.api.java.utils.ParameterTool;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.functions.sink.SinkFunction;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaProducer;

public class KafkaSinkExample {

public static void main(String[] args) throws Exception {

// 获取 Flink 运行环境

StreamExecutionEnvironment environment = StreamExecutionEnvironment.getExecutionEnvironment();

// 读取数据源

DataStream<String> input = environment.socketTextStream("localhost", 9090);

// 写入 Kafka

input.addSink(new FlinkKafkaProducer<>(

"localhost:9092",

"my-topic",

(String value) -> new ProducerRecord<>("my-topic", value),

new FlinkKafkaProducer.FlinkKafkaSerializationSchemaWrapper<String>(

new SimpleStringSchema())));

// 启动 Flink 程序

environment.execute();

}

}

运行该示例,Flink 程序会从本地 localhost:9090 端口读取数据,并将数据写入到 Kafka 的 my-topic 主题中。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。