机器学习PAI补充了一个示例(省略了优化模型),帮确认下切换模型的写法是否有问题?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

这个示例展示的切换GPT-2和GPT-3模型的写法是正确的,它使用了openai.api()构造函数创建了OpenAI API对象,然后可以通过set_engine()方法来切换不同的模型。值得注意的是,每个模型都需要对应的API密钥。

import openai

openai.api_key = "YOUR_API_KEY" model_engine = "davinci" # default engine

def generate_response(prompt, model_engine=model_engine, max_tokens=50): """ Generates response to the prompt using the specified model engine and max tokens. """ # create the request data data = { 'prompt': prompt, 'max_tokens': max_tokens, } # instantiate the OpenAI API object api = openai.api() # set the request model and engine api.set_model_engine(model_engine) # generate the response response = api.Completion.create(engine=model_engine, prompt=prompt, max_tokens=max_tokens) # return the response text return response.choices[0].text.strip()

prompt = "What is the meaning of life?" response = generate_response(prompt) print(response)

model_engine = "text-davinci-002" # GPT-3 engine

response = generate_response(prompt, model_engine=model_engine) print(response) 需要注意以下几点:

首先需要使用凭据来设置OpenAI API密钥:openai.api_key = "YOUR_API_KEY" 然后需要使用所需的引擎名称字符串来设置要使用的引擎:model_engine = "davinci"或model_engine = "text-davinci-002" 接下来在生成响应之前,需要使用api.set_model_engine()方法来切换模型引擎:api.set_model_engine(model_engine) 然后可以使用指定的引擎生成响应:response = api.Completion.create(engine=model_engine, prompt=prompt, max_tokens=max_tokens) 以上代码应该可以很好地控制所需的引擎/模型,并生成相应的响应。

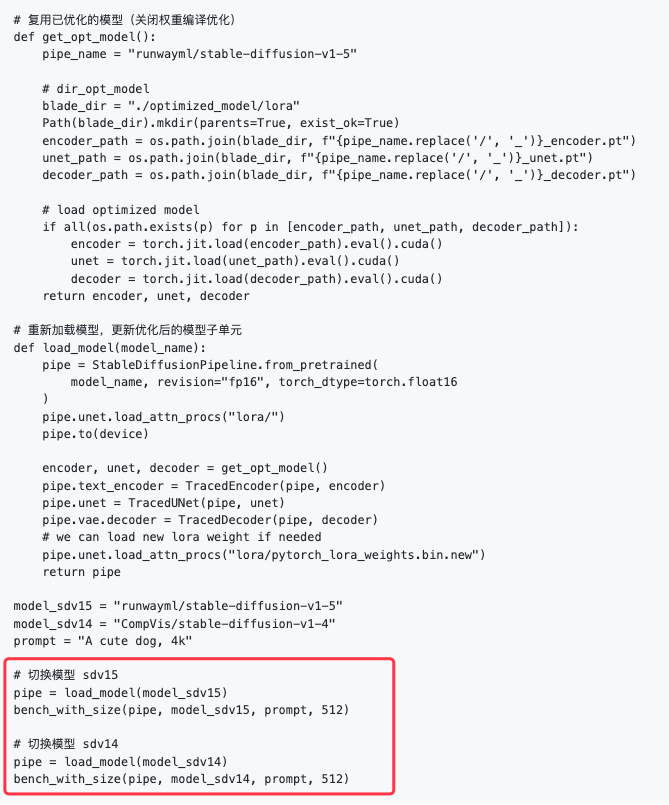

,get_model后需要 encoder.load_state_dict(pipe.encoder.state_dict()) 这样更新一下优化模型的权重,此回答整理自钉群“BladeDISC用户支持群”

,get_model后需要 encoder.load_state_dict(pipe.encoder.state_dict()) 这样更新一下优化模型的权重,此回答整理自钉群“BladeDISC用户支持群”

人工智能平台 PAI(Platform for AI,原机器学习平台PAI)是面向开发者和企业的机器学习/深度学习工程平台,提供包含数据标注、模型构建、模型训练、模型部署、推理优化在内的AI开发全链路服务,内置140+种优化算法,具备丰富的行业场景插件,为用户提供低门槛、高性能的云原生AI工程化能力。