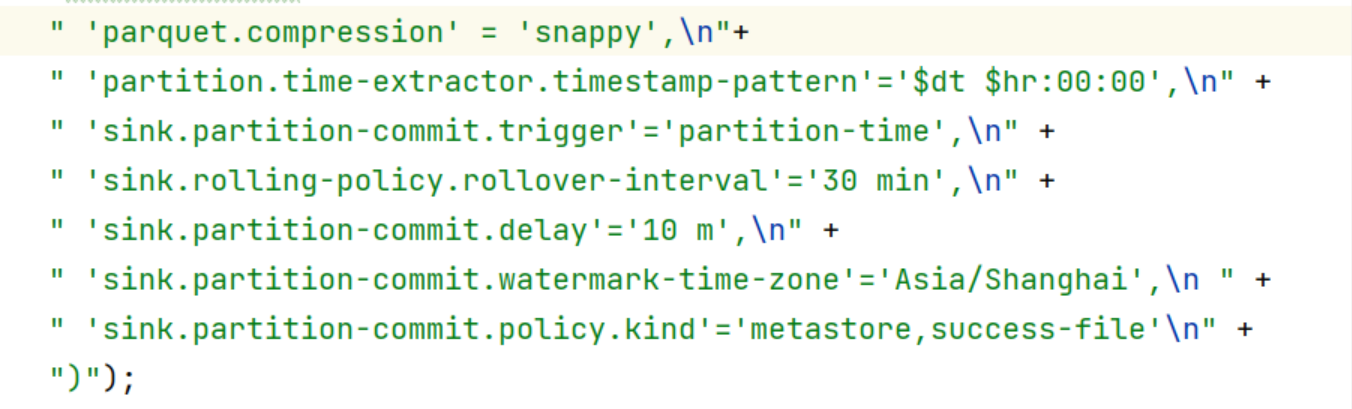

flink写hive我这设置了文件滚动策略,但是还是产生了 很多小文件,这是为什么呢?按照我设置参数的不应该30分钟滚动一个文件吗?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

datasream api 这边是根据 并行度 和 checkpoint 时间相关 ,checkpoint间隔 * 并行度,你看看sql 是不是也是这样。此回答整理自钉钉群”【③群】Apache Flink China社区“

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。