最近看到群里同学们在讨论:“系统要加大模型,workflow 还能用吗?还是要上 Agent?” 表面上是技术选型,实际上是“你希望机器帮你做步骤,还是帮你思考”。

- 大模型最早期:只是一个“聪明的接口”

最早的大模型,其实就是一个“对话式 API”。

举个例子: 用户问:「中国的首都是哪?」 模型回答:「北京」。

用户接着问:「那它的人口呢?」 开发者不得不把前一个问题 + 回答 + 新问题一起发给模型,确保上下文连续。

这里的大模型,本质上只是“搬运数据 + 做推理”,不负责规划流程。 如果任务复杂,你必须自己在外部管理逻辑和步骤。

- Workflow:把“事”拆成固定流水线

随着业务需求越来越复杂,一次问答显然无法满足。于是 workflow 应运而生。

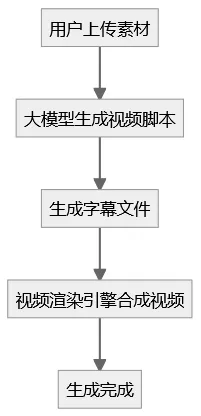

比如,你要生成一条生日祝福视频,流程可能是:

这里的 workflow 有几个特点:

固定流程:先 A 再 B,再 C

明确步骤:哪一步调用大模型,哪一步调用其他工具

人设计:大模型只负责“干活”,不负责“想办法”

可以把 workflow 想象成流水线上的工人:效率高,但遇到异常不会自己变通。

- Agent:让大模型自己“思考 + 决策 + 调用工具”

Agent 的价值在于:大模型可以自主规划流程和处理异常。

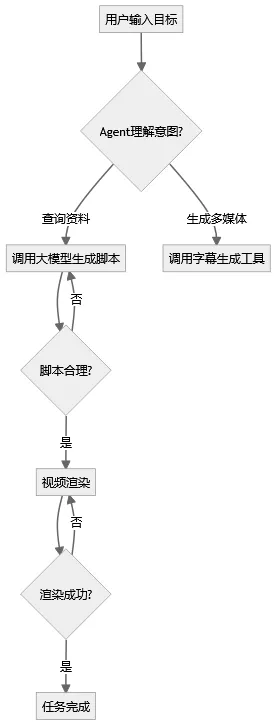

同样是生成生日视频:

Agent 的流程是动态的,可以根据情况分支,甚至自适应重试。 相比 workflow,它更灵活:不固定步骤,更像“有思考力的员工”。

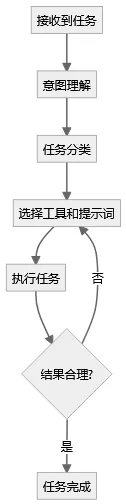

- Agent 内部的 workflow:教它“如何思考”

Agent 也有 workflow,但它不是传统业务流程。

前者是教机器“怎么干活”,后者是教机器“怎么思考”。 也可以理解为:前者是 SOP,后者是“思考路径图”。

- 具体对比如下

简单理解:Workflow 是 SOP,Agent 是会思考的员工。

- 那终究怎么选择?

业务流程稳定、步骤明确 → 用 workflow,可靠高效

任务复杂、需要灵活决策 → 上 Agent,让大模型帮你拆解任务

两者结合 → 底层 workflow 保证可控性,上层 Agent 解放人工,让大模型自己处理异常和优化方案

7.Agent 的价值仅仅在自动化?

Agent 并不是简单的“workflow + LLM”。它的核心价值在于:

意图理解:理解用户目标,而不是执行固定命令

工具选择:根据任务动态选择调用工具

计划生成:拆解任务,规划执行步骤

自适应优化:任务失败时自主调整方案

换句话说,它让大模型从“被动干活”升级到“主动思考”。 对于开发者来说,这意味着可以把重复性、流程化的工作交给 Agent,自己专注于业务设计和结果优化。