06-PDI(Kettle)读取Hive写入HDFS,读取HDFS写入HBase中

本文主要通过Kettle完成对Hive和HBase中数据的读写工作,为了便于按照文档即可实现Kettle的读写Hive和HBase,文本前面也介绍下Hive的安装过程,如何Hive已经完成安装,可跳过前面即可。

实验环境:

cetnos7.4

环境准备

1.安装MySQL

1.1mysql安装参考:

centos7下使用mysql安装包安装mysql5.7

https://www.cnblogs.com/wpnr/p/14072634.html

CentOS7安装MySQL

https://www.cnblogs.com/bigbrotherer/p/7241845.html

1.2安装过程

在CentOS中默认安装有MariaDB,这个是MySQL的分支,但为了需要,还是要在系统中安装MySQL,而且安装完成之后可以直接覆盖掉MariaDB。

1) 下载并安装MySQL

安装官方的 Yum Repository

[root@localhost ~]# wget -i -c http://dev.mysql.com/get/mysql57-community-release-el7-10.noarch.rpm

使用上面的命令就直接下载了安装用的Yum Repository,大概25KB的样子,然后就可以直接yum安装了。

[root@localhost ~]# yum -y install mysql57-community-release-el7-10.noarch.rpm

之后就开始安装MySQL服务器。

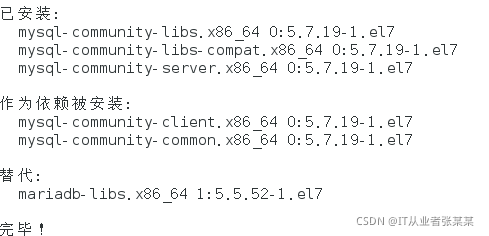

[root@localhost ~]# yum -y install mysql-community-server

这步可能会花些时间,安装完成后就会覆盖掉之前的mariadb。

2) MySQL数据库设置

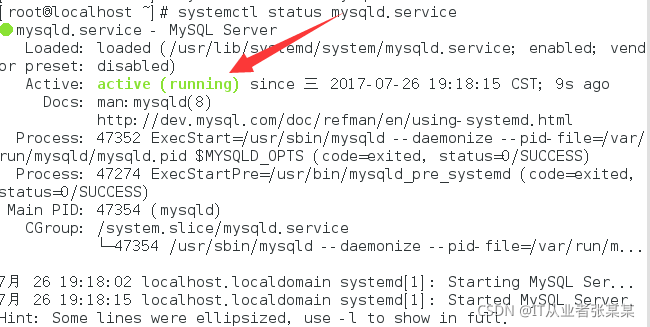

首先启动MySQL

[root@localhost ~]# systemctl start mysqld.service

查看MySQL运行状态,运行状态如图:

[root@localhost ~]# systemctl status mysqld.service • 1

此时MySQL已经开始正常运行,不过要想进入MySQL还得先找出此时root用户的密码,通过如下命令可以在日志文件中找出密码:

[root@localhost ~]# grep "password" /var/log/mysqld.log

如下命令进入数据库:

[root@localhost ~]# mysql -uroot -p

输入初始密码,此时不能做任何事情,因为MySQL默认必须修改密码之后才能操作数据库:

mysql> ALTER USER 'root'@'localhost' IDENTIFIED BY 'new password';

这里有个问题,新密码设置的时候如果设置的过于简单会报错:

原因是因为MySQL有密码设置的规范,具体是与validate_password_policy的值有关:

MySQL完整的初始密码规则可以通过如下命令查看:

mysql> SHOW VARIABLES LIKE 'validate_password%'; +--------------------------------------+-------+ | Variable_name | Value | +--------------------------------------+-------+ | validate_password_check_user_name | OFF | | validate_password_dictionary_file | | | validate_password_length | 4 | | validate_password_mixed_case_count | 1 | | validate_password_number_count | 1 | | validate_password_policy | LOW | | validate_password_special_char_count | 1 | +--------------------------------------+-------+ 7 rows in set (0.01 sec)

密码的长度是由validate_password_length决定的,而validate_password_length的计算公式是:

validate_password_length = validate_password_number_count + validate_password_special_char_count + (2 * validate_password_mixed_case_count)

我的是已经修改过的,初始情况下第一个的值是ON,validate_password_length是8。可以通过如下命令修改:

mysql> set global validate_password_policy=0; mysql> set global validate_password_length=1;

设置之后就是我上面查出来的那几个值了,此时密码就可以设置的很简单,例如1234之类的。到此数据库的密码设置就完成了。

但此时还有一个问题,就是因为安装了Yum Repository,以后每次yum操作都会自动更新,需要把这个卸载掉:

[root@localhost ~]# yum -y remove mysql57-community-release-el7-10.noarch

此时才算真的完成了。

2.安装HIVE

2.1参考:

https://blog.csdn.net/qq_44870331/article/details/116733919

2.2hadoop配置:

mapred-site.xml

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

yarn-site.xml

<configuration> <property> <name>yarn.resourcemanager.hostname</name> <value>cm-cdh20</value> </property> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration>

2.3hive安装过程

1)下载hive:

1.下载HIVE:

yum -y install wget wget https://dlcdn.apache.org/hive/stable-2/apache-hive-2.3.9-bin.tar.gz

2.解压安装hive:

tar -zxvf apache-hive-2.3.9-bin.tar.gz

3 重命名hive

mv apache-hive-2.3.9-bin /opt/apps/hive

4 配置hive环境变量

vi ~/.bash_profile or vi /etc/profile

vi用法:

输入v+ j/k/h/l 进行文本选中 对于选中的文本进行如下按键: (1.1)d ------ 剪切操作 (1.2)y -------复制操作 (1.3)p -------粘贴操作 (1.4)^ --------选中当前行,光标位置到行首(或者使用键盘的HOME键) (1.5)$ --------选中当前行,光标位置到行尾(或者使用键盘的END键) (2)Visual Line模式 按键V可以进入 按键V之后,进入Visual Line模式,使用 j/k键可以选中一行或者多行 (3)Visual Block模式,按键Ctrl + V可以进入 按键Ctrl+V之后,进入Visual Block模式,使用 j/k/h/l键可以选中一块

5 添加

export HIVE_HOME=/opt/apps/hive export PATH=$HIVE_HOME/bin:$PATH

6 刷新配置文件

source ~/.bash_profile or source /etc/profile

7 文件移动到 hive的lib

将mysql-connector-java-5.1.49.jar 文件移动到 hive的lib文件夹下

find / -name mysql-connectors-java* cp mysql-connector-java-5.1.49.jar $HIVE_HOME/lib

8 创建数据库,配置用户和权限

(1)创建数据库

mysql>create database metastore;

(2)创建MySQL的 用户hive,密码new_passwd 并赋予权限*

mysql>grant all on metastore.* to hive@'%' identified by 'new_passwd'; mysql>grant all on metastore.* to hive@'localhost' identified by 'new_passwd'; mysql>grant all on *.* to root@'%' identified by 'new_passwd';

(3)刷新MySQL权限

mysql>flush privileges;

用命令创建:hive数据库

[root@master ~]# mysql -u root -p mysql>create database hive;

2)hive配置文件

1 进入Hive的配置文件所在路径

cd $HIVE_HOME/conf cp hive-env.sh.template hive-env.sh cp hive-default.xml.template hive-site.xml cp hive-log4j2.properties.template hive-log4j2.properties cp hive-exec-log4j2.properties.template hive-exec-log4j2.properties

2.修改hive-env.sh

vi hive-env.sh

如果没有配置以下环境变量/或是系统有jdk,hadoop多个环境, 可以手动指定想要版本的地址

export JAVA_HOME=/opt/apps/jdk export HADOOP_HOME=/opt/apps/hadoop

3.增加hive-site.xml

vi hive-site.xml

用于配置MySQL的关联

注意:下面xml里的ConnectionUserName和ConnectionPassword配置的是mysql的用户名密码,

上文已经设置过都是hive,如果上文自己设置别的用户名密码,请自行修改.

<?xml version="1.0" encoding="UTF-8" standalone="no"?> <configuration> <property> <name>hive.exec.scratchdir</name> <value>/opt/apps/hive/tmp</value> </property> <!--默认的存储地址--> <property> <name>hive.metastore.warehouse.dir</name> <value>hdfs://cm-cdh20:9000/user/hive/warehouse</value> <!-- <value>/opt/apps/hive/warehouse</value> --> </property> <property> <name>hive.querylog.location</name> <value>/opt/hive/log</value> </property> <!-- 配置 MySQL 数据库连接信息 --> <property> <name>javax.jdo.option.ConnectionURL</name> <value>jdbc:mysql://192.168.33.200:3306/hive?createDatabaseIfNotExist=true&characterEncoding=UTF-8&useSSL=false</value> </property> <property> <name>javax.jdo.option .ConnectionDriverName</name> <value>com.mysql.jdbc.Driver</value><!-- jdbc驱动 --> </property> <property> <name>javax.jdo.option.ConnectionUserName</name> <value>root</value><!-- mysql账号 --> </property> <property> <name>javax.jdo.option.ConnectionPassword</name> <value>111111</value><!-- mysql密码 --> </property> <property> <name>hive.server2.authentication</name> <value>NONE</value> </property> <property> <name>hive.server2.thrift.client.user</name> <value>root</value> <description>Username to use against thrift client</description> </property> <property> <name>hive.server2.thrift.client.password</name> <value>111111</value> <description>Password to use against thrift client</description> </property> <property> <name>hive.server2.enable.doAs</name> <value>false</value> </property> <property> <name>hive.server2.logging.operation.log.location</name> <value>/opt/apps/hive/logs/hive/hiveserver2</value> </property> <!-- 这是hiveserver2 --> <property> <name>hive.server2.thrift.port</name> <value>10000</value> </property> <property> <name>hive.server2.thrift.bind.host</name> <value>192.168.33.200</value> </property> </configuration>

4.创建hive的hdfs工作目录

$HADOOP_HOME/bin/hadoop fs -mkdir -p /tmp $HADOOP_HOME/bin/hadoop fs -mkdir -p /user/hive/warehouse $HADOOP_HOME/bin/hadoop fs -chmod g+w /tmp $HADOOP_HOME/bin/hadoop fs -chmod g+w /user/hive/warehouse

3)初始化hive

同上,下面 命令最后结尾是 是MySQL的用户名 hive和密码hive

cd $HIVE_HOME/bin ./schematool -dbType mysql -initSchema root new_passwd

提示如下成功

[root@cm-cdh20 bin]# ./schematool -dbType mysql -initSchema root 111111 --verbose ... 0: jdbc:mysql://192.168.33.200:3306/hive> /*!40111 SET SQL_NOTES=@OLD_SQL_NOTES */ No rows affected (0.001 seconds) 0: jdbc:mysql://192.168.33.200:3306/hive> !closeall Closing: 0: jdbc:mysql://192.168.33.200:3306/hive?createDatabaseIfNotExist=true&characterEncoding=UTF-8&useSSL=fal se beeline> beeline> Initialization script completed schemaTool completed

3.启动hive

先启动hadoop

start-dfs.sh start-yarn.sh mr-jobhistory-daemon.sh start historyserver

192.168.33.200:19888

# 启动元数据服务 hive --service metastore & # 启动hiveserver2 hive --service hiveserver2 & 指定配置文件 hive --service hiveserver2 --hiveconf hive.server2.thrift.port 10001

通过thrift连接hiveserver2

beeline !connect jdbc:hive2://192.168.33.200:10000 !quit

设计Kettle转换

1.开启hive

1.1配置hive依赖

Kettle关于Hadoop生态圈组件连接配置基本都在data-integration\plugins\pentaho-big-data-plugin目录下,如图:

(1)active.hadoop.configuration

The Hadoop Configuration to use when communicating with a Hadoop cluster. This is used for all Hadoop client tools

including HDFS, Hive, HBase, and Sqoop.

For more configuration options specific to the Hadoop configuration choosen

here see the config.properties file in that configuration’s directory.

active.hadoop.configuration=hdp30

(2)hadoop.configurations.path

Path to the directory that contains the available Hadoop configurations

hadoop.configurations.path=hadoop-configurations

两个参数主要配置Hadoop集群的版本,在hadoop-configurations目录下,提供了如下几个Hadoop集群版本:

其中cdh和hdp是目前用的比较多的两个版本。它们整合了Hadoop集群的各个组件,可以快速配置和部署。本文选中选择hdp26,在选择hdp30的时候,出现一些依赖的冲突。

我们这里连接Hive2,需要Hadoop集群支持,所以将Hadoop的配置文件core-site.xml,hdfs-site.xml和Hive的配置文件hive-site.xml拷贝过来(事先需要搭建好Hadoop和Hive集群)。

1.2hive建表

分别开启 hdfs/yarn/hbase/hive服务

# 开启hdfs start-dfs.sh # 开启yarn start-yarn.sh # 开启yarn历史记录服务器 192.168.33.200:19888 mr-jobhistory-daemon.sh start historyserver # 开启hive元数据服务 hive --service metastore & # 开启hive 远程服务 ,也可在开启的时候指定thrift的端口号 hive --service hiveserver2 & # hive --service hiveserver2 --hiveconf hive.server2.thrift.port 10001 # 通过beeline链接thrift,访问hive的server2 beeline # 在beeline终端下,访问hive2 !connect jdbc:hive2://192.168.33.200:10000 # 退出beeline !quit # 开启hbase start-hbase.sh

进入hive,建立相关表

drop database if exists kettle cascade; create database if not exists kettle; use kettle; create table if not exists kettle.dept( deptno int, dname string, loc string ) row format delimited fields terminated by '\t' ; insert into kettle.dept values(10,'Java','Beijing'),(20,'Bigdata','hangzhou'),(30,'Html5','Shanghai'),(40,'UI','Chongqing'); create table if not exists kettle.emp( empno int, ename string, job string, mgr int, hiredata string, sal double, comm int, deptno int ) row format delimited fields terminated by '\t' ; insert into kettle.emp values(1111,'liyi','Bigdata Programer',1000,'2020-02-02',1,100000,20),(1000,'laoma','Bigdata Mananger',0,'1990-01-01',1000000,2000000,20),(1112,'laoxue','Java Programer',1000,'1996-02-02',100000,20000,10),(1113,'wangdan','UI Desgner',1000,'1997-02-02',10000,2000,40);