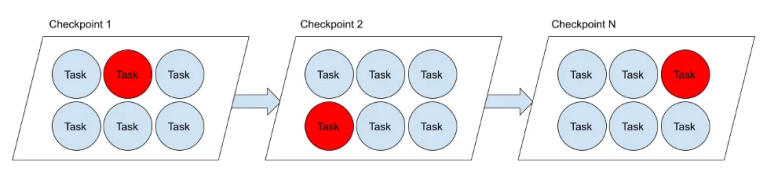

为什么现有的 Incremental Checkpoint 在实际中不能完全减少每次 Checkpointing 所需持久化存储状态的大小?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

现有的 Incremental Checkpoint 是基于 RocksDB 来完成的,但 RocksDB 会定期做 Compaction 来优化空间放大和读性能,这会产生新的、相对较大的文件,从而增加上传所需要的时间。此外,随着物理节点的增多,Checkpoint 被延迟的概率也会增大。