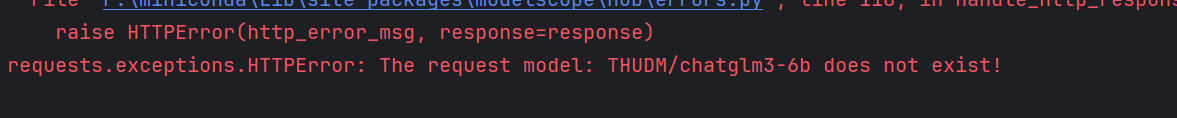

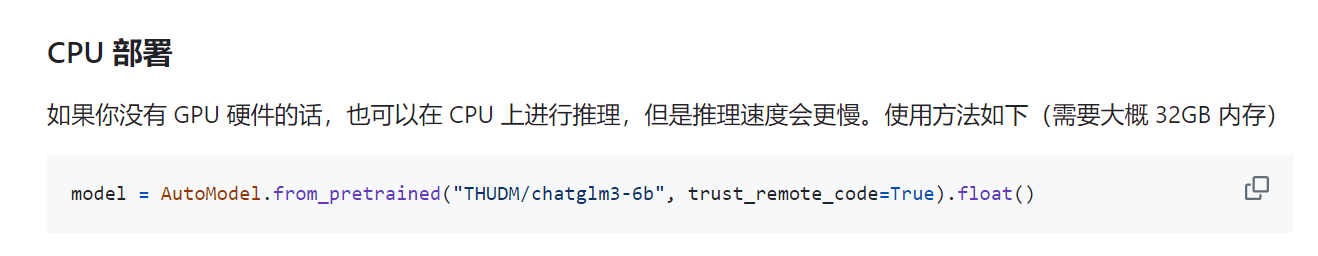

在modelscope上git上这个语句报错,我是CPU版本,怎么回事?chatglm.cpp: 类似 llama.cpp 的量化加速推理方案,实现笔记本上实时对话

chatglm.cpp: 类似 llama.cpp 的量化加速推理方案,实现笔记本上实时对话。此回答整理自钉钉群“魔搭ModelScope开发者联盟群 ①”

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352