"CUDA_VISIBLE_DEVICES=2,3,4,5 swift export \

--model_type baichuan2-7b-chat \

--model_id_or_path /workspace/model/llm/baichuan2/Baichuan2-7B-Chat \

--quant_bits 4 \

--dataset ms-bench-mini \

--quant_method awq \

--tensor_parallel_size 4 \

--gpu_memory_utilization 0.6 \

--max_model_len 1024 \

--use_flash_attn True 报错的都是oom,显存爆了,不用加哪些modelscope参数?"

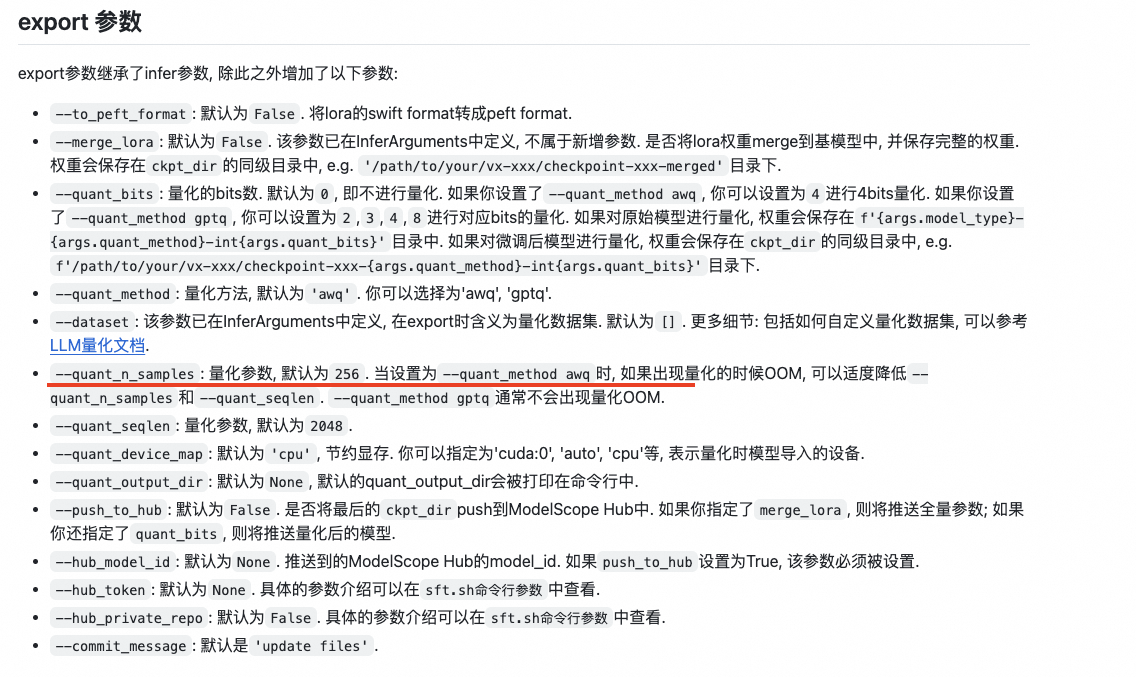

"参考以下图片

推理时爆显存可以设置-tensor_parallel_size 4 \

--gpu_memory_utilization 0.6 \

--max_model_len 1024 \参数。 此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”"

减小批量大小(Batch Size):

如果命令中可以指定批量大小,尝试减小它。较小的批量大小会减少每次迭代的显存需求。

调整--quant_n_samples和--quant_seqlen:

对于AWQ量化,减小--quant_n_samples(默认值通常是256)和--quant_seqlen(默认值通常是2048)可以减少量化过程中的显存占用。

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352