modelscope-funasr哪个模型可以识别成这样的呢?

这个有试出来的吗?我去MFCCA的魔塔界面复制了几个demo,一个都没跑起来,卡在了这个错误:ModuleNotFoundError: No module named 'funasr.datasets.ms_dataset。百度说funasr或者modelscope的版本不兼容,我funasr是1.2.6,modelscope是1.25.0

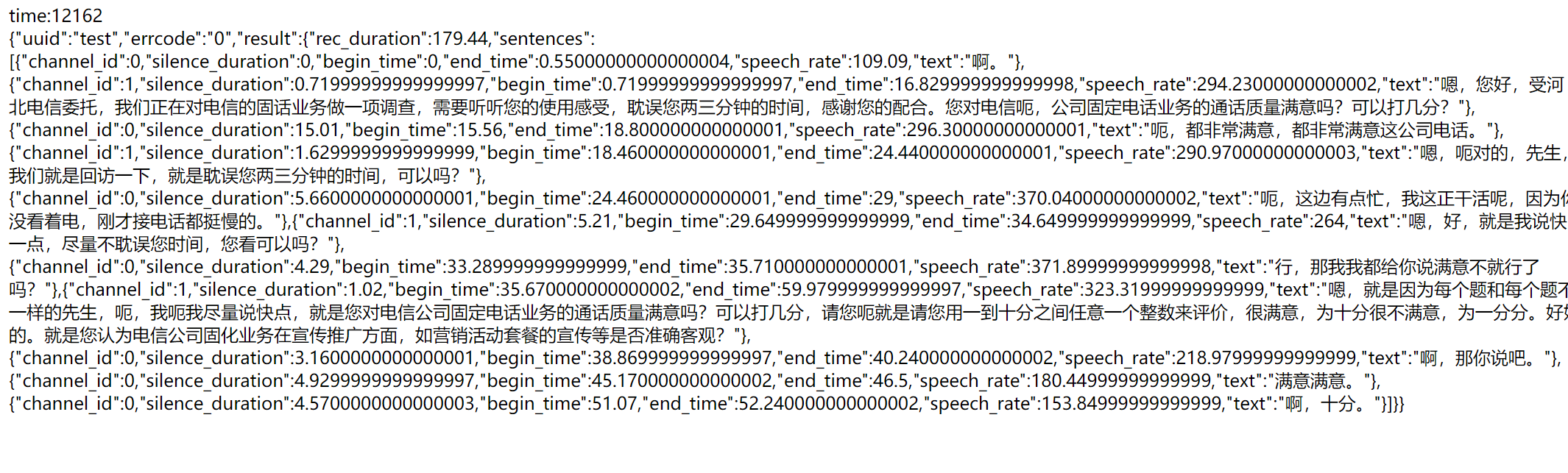

MFCCA模型能够识别会议场景下的多说话人语音。

ModelScope-FunASR中的MFCCA模型是专门为解决会议场景下多说话人语音识别问题而设计的。这个模型基于ICASSP2022 M2MeT竞赛中使用的真实会议场景语料库AliMeeting进行训练,并且在该数据集上实现了最新的SOTA(State of the Art,顶尖水平)性能。具体来说,以下是关于MFCCA模型的一些详细信息:

综上所述,如果您需要识别包含两个或以上说话人的语音,MFCCA模型是一个值得考虑的选择。您可以利用ModelScope平台提供的资源和工具,对模型进行进一步的调整和优化,以满足您的具体需求。