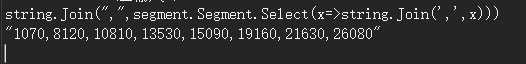

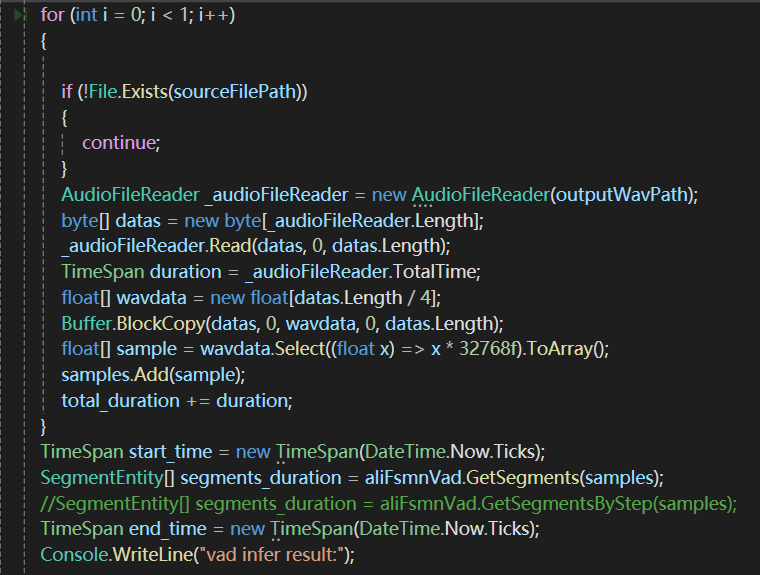

在modelscope-funasr官方的示例音频 ,用vad出来的有26秒,实际是13秒,怎么回事?

使用ModelScope-Funasr的VAD模块处理官方示例音频时,出现识别时长比实际音频时长长的情况,可能是由于几个原因造成的:

max_end_silence_time,它用于控制识别结束时的最长静音时间。如果在这个时间内没有检测到任何语音活动,则认为语音已经结束,识别过程将停止。如果这个参数设置得过长,就可能导致在语音结束后仍有较长时间才停止识别。总的来说,如果您遇到这样的问题,建议检查并调整max_end_silence_time参数的设置,尝试在更安静的环境中录音,或者调整VAD的灵敏度设置,以优化识别效果。同时,也可以考虑查看官方文档或社区论坛,看是否有其他用户遇到类似问题并提供了解决方案。如解决,可以向ModelScope-Funasr的维护者报告此问题,以便进一步的调查和修复。