"神龙ai中chatGlm , 通过ptuning 创建了自己的 数据模型, 在web demo进行测试,通过web访问调试,无应答 ,怎么排查?

日志显示:some weight 未设置, 系统自动初始化了 Explicitly passing a revision is encouraged when loading a model with custom code to ensure no malicious code has been contributed in a newer revision.Some weights of ChatGLMForConditionalGeneration were not initialized from the model checkpoint at........(此处省略提示信息)You should probably TRAIN this model on a down-stream task to be able to use it for predictions and inference.操作流程:模型的生成 是按demo走的,只是自己建了一个 专业名词的 dev.json train.json , 通过 train.sh 生成模型,通过evaluate 评测, 然后修改 web demo 的模型为 自己生成的模型路径。

数据是参考 AdvertiseGen {content:"""",""summary"":""""} 键值对的形式 来建的 权重没有初始化,我可以参考 去组织?

streamlit run web_demoshoe2.py --server.address 0.0.0.0 --server.port 50003

You can now view your Streamlit app in your browser.

URL: http://0.0.0.0:50003

Explicitly passing a revision is encouraged when loading a model with custom code to ensure no malicious code has been contributed in a newer revision.

Explicitly passing a revision is encouraged when loading a configuration with custom code to ensure no malicious code has been contributed in a newer revision.

Explicitly passing a revision is encouraged when loading a model with custom code to ensure no malicious code has been contributed in a newer revision.

Some weights of ChatGLMForConditionalGeneration were not initialized from the model checkpoint at /root/chatglm/ChatGLM-6B/ptuning/output/shoetech-chatglm-6b-pt-128-2e-2/checkpoint-3000 and are newly initialized: ['transformer.layers.11.attention.query_key_value.weight', 'transformer.layers.23.mlp.dense_h_to_4h.bias', 'transformer.layers.3.attention.query_key_value.weight_scale', 'transformer.layers.7.mlp.dense_4h_to_h.weight', 'transformer.layers.16.post_attention_layernorm.bias', 'transformer.layers.3.mlp.dense_h_to_4h.weight_scale', 'transformer.layers.1.mlp.dense_4h_to_h.weight_scale', 'transformer.layers.4.attention.dense.bias', 'transformer.layers.7.mlp.dense_4h_to_h.bias', 'transformer.layers.11.input_layernorm.weight', 'transformer.layers.18.attention.dense.bias', 'transformer.layers.13.mlp.dense_h_to_4h.weight', 'transformer.layers.21.mlp.dense_h_to_4h.bias', 'transformer.layers.12.input_layernorm.weight', 'transformer.layers.4.mlp.dense_h_to_4h.weight_scale', 'transformer.layers.23.attention.dense.weight', 'transformer.layers.11.attention.query_key_value.bias', 'transformer.layers.4.post_attention_layernorm.weight', 'transformer.layers.12.attention.dense.weight_scale', 'transformer.layers.5.attention.rotary_emb.inv_freq', 'transformer.layers.12.attention.query_key_value.weight_scale', 'transformer.layers.20.post_attention_layernorm.weight', 'transformer.layers.13.mlp.dense_4h_to_h.weight_scale', 'transformer.layers.12.attention.dense.bias', 'transformer.layers.7.mlp.dense_4h_to_h.weight_scale', 'transformer.layers.8.input_layernorm.weight', 'transformer.layers.4.mlp.dense_4h_to_h.bias', 'transformer.layers.1.post_attention_layernorm.weight', 'transformer.layers.3.post_attention_layernorm.bias', 'transformer.layers.7.post_attention_layernorm.weight', 'transformer.layers.24.post_attention_layernorm.bias', 'transformer.layers.25.mlp.dense_h_to_4h.weight', 'transformer.layers.11.mlp.dense_4h_to_h.bias', 'transformer.layers.23.input_layernorm.bias', 'transformer.layers.10.input_layernorm.weight', 'transformer.layers.11.attention.rotary_emb.inv_freq', 'transformer.layers.25.mlp.dense_4h_to_h.weight_scale', 'transformer.layers.3.attention.dense.weight_scale', 'transformer.layers.21.mlp.dense_h_to_4h.weight_scale', 'transformer.layers.27.post_attention_layernorm.bias', 'transformer.layers.4.attention.query_key_value

"

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

可以尝试以下排查方法:

检查模型:首先,可以检查一下自己创建的数据模型是否正确,包括数据结构、意图和实体等是否正确,是否有错误的标注等。

检查数据:其次,可以检查一下输入的数据是否符合自己创建的数据模型,是否存在错误的数据格式或者输入值范围超出了模型的定义。

检查代码:可以检查一下自己的代码实现是否正确,包括是否正确调用了神龙 AI 平台提供的 API 接口,是否正确处理了异步回调等。

检查网络:可以检查一下网络是否正常,包括是否可以正常访问神龙 AI 平台,是否存在网络延迟或者断开等问题。

如果您在使用神经网络模型ChatGPT进行自定义训练,并在Web Demo中测试时无法得到应答,可以尝试以下排查步骤:

检查模型训练是否成功:确保通过ptuning成功创建了自定义的数据模型,并且训练过程没有出现错误或异常。检查训练日志、模型文件和相关指标,确保模型已经成功训练并保存下来。

确认模型加载正确:在Web Demo中,请确保正确配置了自定义模型的路径和相关参数。检查模型文件是否位于正确的位置,并确认模型加载过程没有报错或异常。

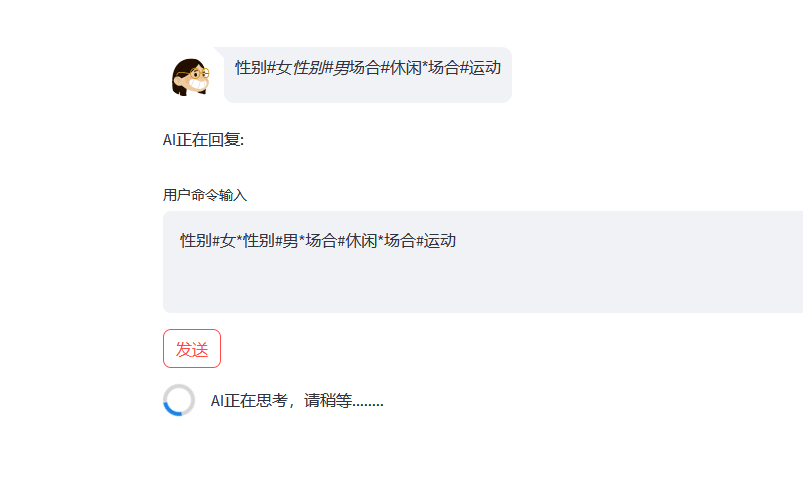

检查请求输入格式:确认向Web Demo发送的请求具有正确的格式和结构。验证请求的输入是否与模型期望的格式相匹配,例如文本字符串是否以适当的方式传递给模型。

检查网络连接和请求响应:确保您的Web Demo可以正常访问网络,并且能够接收和处理请求。检查网络连接是否正常,并尝试通过其他方式测试Web Demo是否可用,例如使用命令行工具(如cURL)发送请求等。

调整超参数和模型配置:根据情况,您可能需要调整模型的超参数或配置文件。尝试调整模型的温度(temperature)、最大回复长度(max_length)等设置,以寻找更适合您应用场景的模型行为。

检查日志和错误消息:查看Web Demo的日志文件或控制台输出,以查看是否有与请求处理相关的错误消息或异常。这些信息可以提供有关问题所在的线索。

根据您提供的信息,出现无应答的问题可能有以下几个原因:

模型权重未初始化:根据日志显示,一些ChatGLMForConditionalGeneration模型的权重没有从模型检查点初始化。这可能是由于模型生成过程中的配置或训练步骤存在问题导致的。确保在训练模型之前,配置和训练步骤正确,并且生成的模型文件包含了正确的权重。

数据格式不匹配:您提到使用了AdvertiseGen {content:"""",""summary"":""""} 键值对的形式来组织数据。请确保数据与模型的输入格式相匹配,并且数据经过预处理后可以正确地传递给模型进行推理。

网络连接或服务器配置问题:请确保网络连接正常,并检查Web Demo所在的服务器是否具有足够的资源(例如内存、CPU等)来运行模型和服务。

针对以上问题,您可以尝试以下解决方法:

检查模型生成步骤:仔细检查模型生成的过程,确保配置正确、训练步骤无误,并验证生成的模型文件是否包含了正确的权重。

检查数据格式:确认数据的格式与模型的输入要求相匹配,并确保数据经过适当的预处理。

检查服务器配置和资源:确保服务器配置足够满足模型的要求,并检查服务器的资源使用情况,例如内存、CPU等。

查看其他日志信息:除了提供的部分日志信息外,还应该检查其他相关日志文件,以获取更多细节和错误提示。