Flink CDC Oraclecdc 增量的时候异常,这个问题有大佬遇到过吗

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在使用Flink CDC进行Oracle增量同步时,可能会遇到一些异常问题。根据知识库中的相关资料,以下是可能导致异常的原因及解决方案:

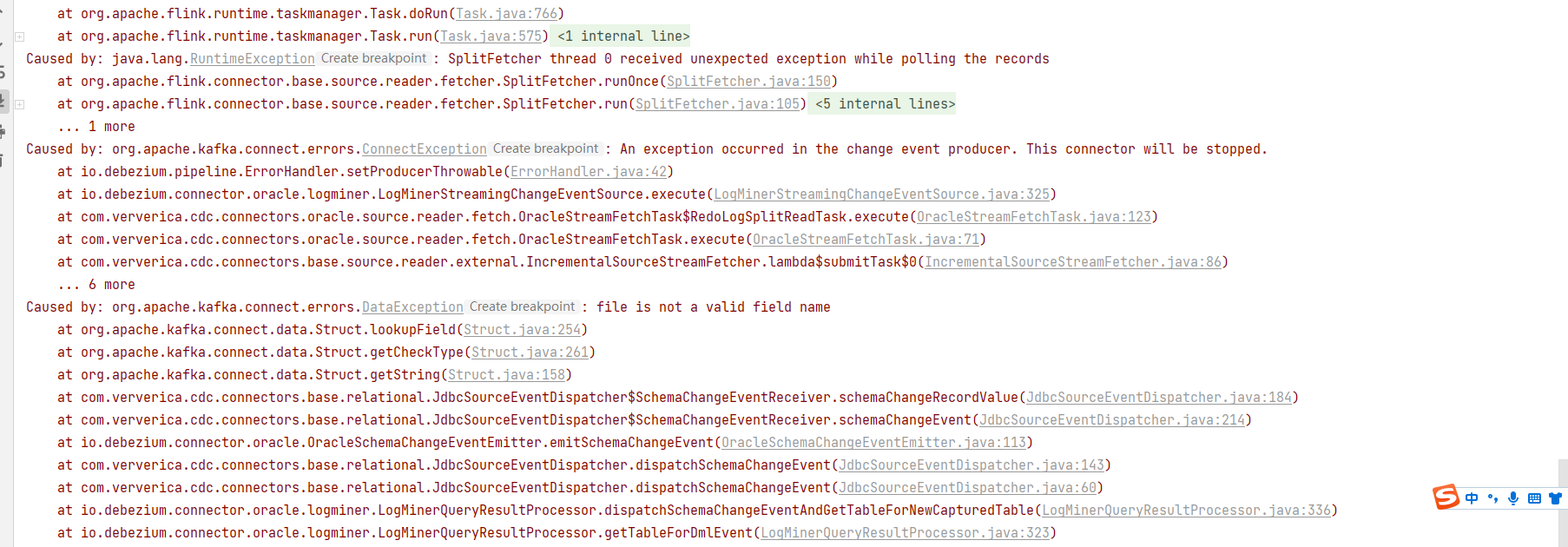

Oracle LogMiner不支持在PDB上执行的错误。debezium.database.pdb.name参数,指定目标PDB名称。ORA-00942: 表或视图不存在。UPDATE LOG_MINING_FLUSH SET LAST_SCN =语句执行失败。LOG_MINING_FLUSH表。DataException: file不是有效的字段名的错误。startScn和endScn参数加载相关日志文件,并使用V$LOGMNR_CONTENTS视图读取解析后的CDC数据。解决方案:

-- 查询当前账户:

SELECT user FROM dual;

-- 检查权限:

SELECT * FROM session_privs;

at-least-once的投递语义,可能导致重复事件。table.exec.source.cdc-events-duplicate=true。PRIMARY KEY,Flink会生成一个额外的有状态算子,使用PRIMARY KEY对变更事件去重并生成规范化的changelog流。SHOW MASTER STATUS命令检查Binlog_Do_DB和Binlog_Ignore_DB配置。timestamp字段时区相差8小时,可能是server-time-zone参数未与Oracle服务器时区一致。serverTimeZone处给定时区信息。以上是Flink CDC在Oracle增量同步过程中可能遇到的异常及其解决方案。如果问题仍未解决,建议结合具体错误日志进一步排查,或者联系阿里云技术支持团队获取帮助。