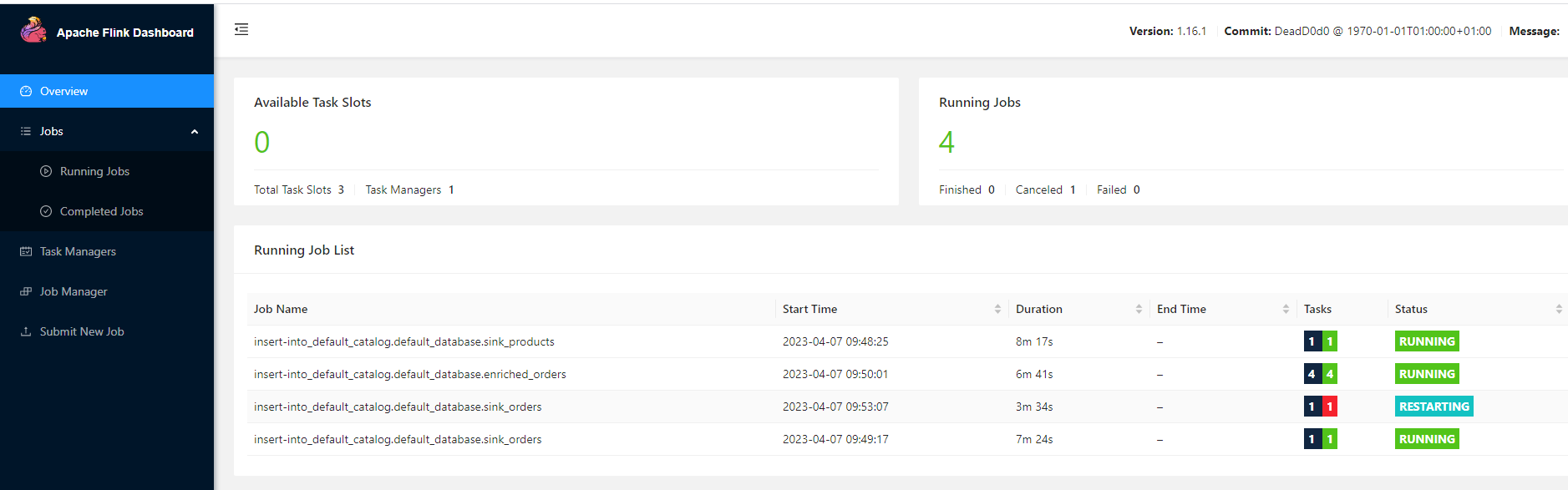

我如果有10张源表需要同步到目标库的10张表,那我是不是需要创建10个job?每个表对应一个job?我如果在单机模式下使用时,10个job是在一个taskmanager下吗?一个taskManager下有多少个slot就能放多少个job?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

你可以看看 Dinky,一个开源项目,这个项目可以做到多个 job ,一个任务。 用 sql 的话,肯定得分10个任务,如果你用 DataStream 的话,可以实现一个任务10张表景文 此答案整理自钉群“Flink CDC 社区”

在阿里云实时计算Flink中,您可以创建一个包含多个数据流转换和分支的作业来同步10个源表到目标库的10个表。这个作业可以使用Flink DataSet API来编写,它可以并行处理数据,并使用Flink提供的数据源和数据接收器来读取和写入数据。

当在单机模式下使用Flink时,可以通过指定适当的配置参数(如并行度和内存分配)来控制每个作业使用的资源。当所有10个作业都在同一个TaskManager下运行时,它们将共享TaskManager的资源,并根据资源需求自适应地分配Slot。Slot的数量由TaskManager的可用资源决定,因此,每个TaskManager可以容纳多个Slot,但具体数量取决于计算资源的利用率、内存消耗和内存分配策略等因素。通常每个TaskManager可以容纳多个Slot,但具体数量取决于您的数据集大小和任务的复杂性。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。