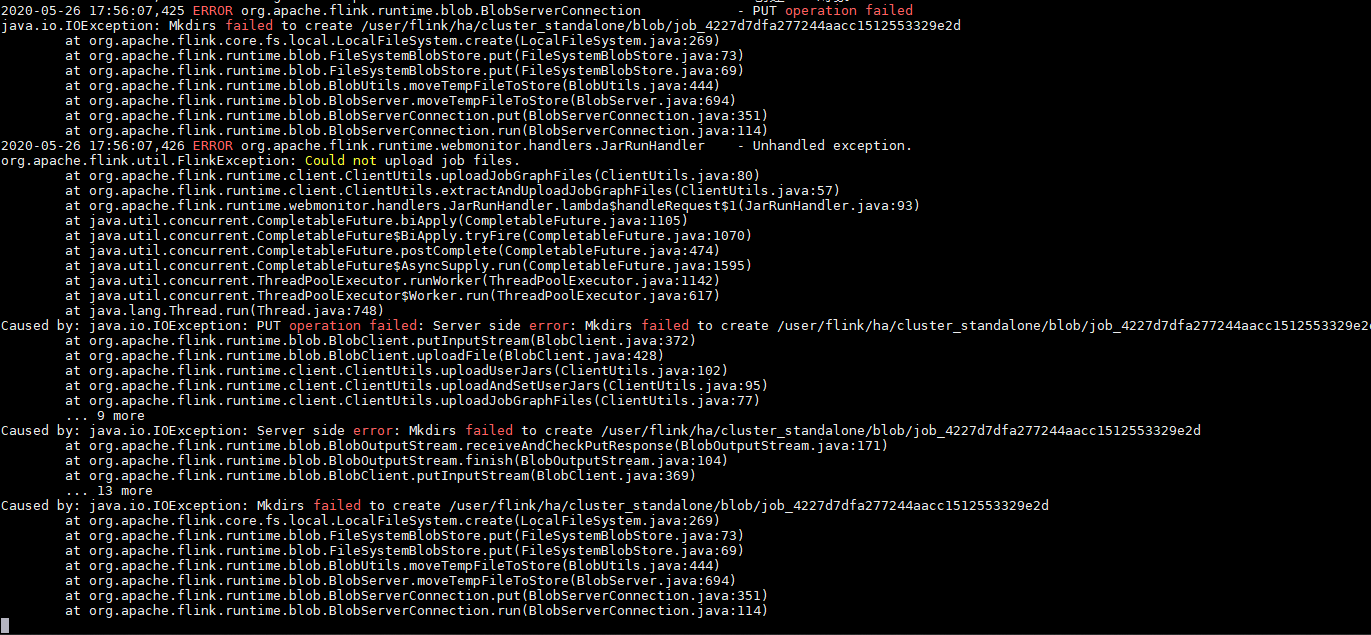

在standalone启动job的时候报错,有大佬帮忙看一下吗?HADOOP_CONF_DIR已经在环境变量中了。也不得行,看不到具体什么原因不能创建 #Flink

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

hdfs 的目录是否存在呢?hdfs dfs -ls /user/flink/ha/cluster_standalone/blob/;你是啥用户在运行 flink 任务?用户是否有写权限,属主是 flink , 你就应该用 flink 用户运行任务,应该是没权限