一、本文介绍

本文记录的是利用大核选择模块LSK优化RT-DETR的目标检测网络模型。在大尺寸图像中的小目标检测任务中,一直是个难题,无法仅基于外观实现较好的识别,因此需要广泛的上下文信息进行辅助。但不同物体所需的上下文信息范围不同,为了更好地对这些特性进行建模,本文利用大核选择模块二次创新ResNetLayer,==使模型能够产生具有各种大感受野的多个特征的同时,动态地根据输入调整模型的行为,使网络更好地适应图像中不同物体的检测需求。==

专栏目录:RT-DETR改进目录一览 | 涉及卷积层、轻量化、注意力、损失函数、Backbone、SPPF、Neck、检测头等全方位改进

专栏地址:RT-DETR改进专栏——以发表论文的角度,快速准确的找到有效涨点的创新点!

二、大核选择模块(LSK)介绍

Large Selective Kernel Network for Remote Sensing Object Detection

LSK module是Large Selective Kernel Network (LSKNet)中的核心模块,以下是对其设计的出发点、原理、结构和优势的详细解释:

2.1 出发点

- 利用遥感图像特性:遥感图像具有独特的特征,如从鸟瞰视角以高分辨率拍摄,其中的物体可能较小且难以仅基于外观识别,需要广泛的上下文信息进行准确检测,且不同物体所需的上下文信息范围不同。为了更好地对这些特性进行建模,提出了

LSK module。 - 结合大核与选择性机制:大核卷积在一些研究中显示出对扩大感受野的有效性,而选择性机制可以动态地根据输入调整模型的行为。将两者结合可以使网络更好地适应遥感图像中不同物体的检测需求。

2.2 原理

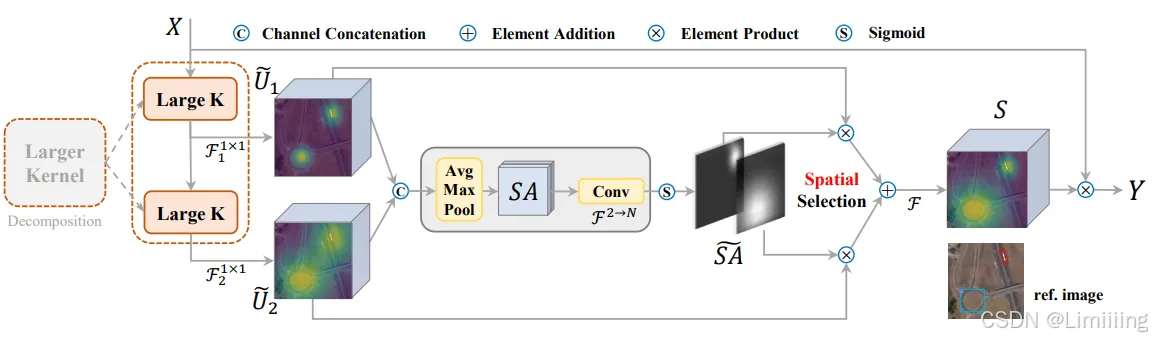

2.2.1 大核卷积分解

- 根据对遥感图像的分析,为了自适应地选择和建模多个长程上下文,将大核卷积明确分解为一系列具有逐渐增大的核和扩张率的深度卷积。

- 对于第$i$个深度卷积,核大小$k_i$、扩张率$d_i$和感受野$RF_i$满足特定的定义关系,以确保感受野能够快速扩展,同时设置扩张率的上界以避免特征图之间出现间隙。

2.2.2 空间核选择

- 通过将不同感受野范围的内核获得的特征进行拼接,然后应用基于通道的平均和最大池化来提取空间关系,得到平均和最大池化的空间特征描述符。

- 将这些空间特征描述符进行拼接,并使用卷积层将其转换为$N$个空间注意力图。

- 对每个空间注意力图应用sigmoid激活函数,得到每个分解后的大内核的空间选择掩码,用于对相应的特征图进行加权,然后融合得到注意力特征。

2.3 结构

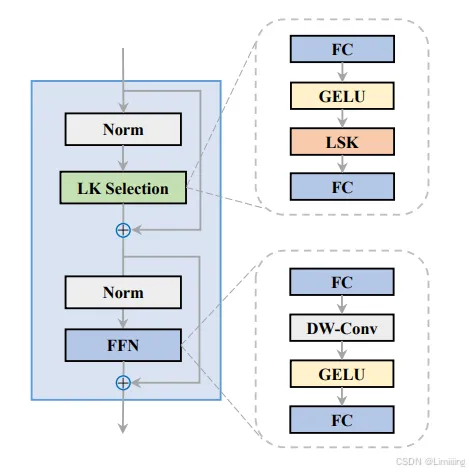

- 嵌入LK Selection子块:

LSK module嵌入在LSKNet的Large Kernel Selection (LK Selection)子块中。 - 包含卷积和选择机制:由一系列大核卷积和一个空间核选择机制组成。

2.4 优势

- 提供多感受野特征:

大核卷积的分解明确地产生了具有各种大感受野的多个特征,这有利于后续的内核选择,能够更好地适应不同物体对不同范围上下文信息的需求。 - 提高效率:与直接应用单个更大的内核相比,顺序分解的方式更高效。在相同的理论感受野下,分解的设计大大减少了参数数量。

- 有效聚焦空间上下文:空间选择机制能够增强网络聚焦于检测目标最相关的空间上下文区域的能力,有助于提高检测性能,并且在实验中显示出比通道注意力机制更适合遥感物体检测任务。

论文:https://openaccess.thecvf.com/content/ICCV2023/papers/Li_Large_Selective_Kernel_Network_for_Remote_Sensing_Object_Detection_ICCV_2023_paper.pdf

源码:https://github.com/zcablii/Large-Selective-Kernel-Network

三、实现代码及RT-DETR修改步骤

模块完整介绍、个人总结、实现代码、模块改进、二次创新以及各模型添加步骤参考如下地址: